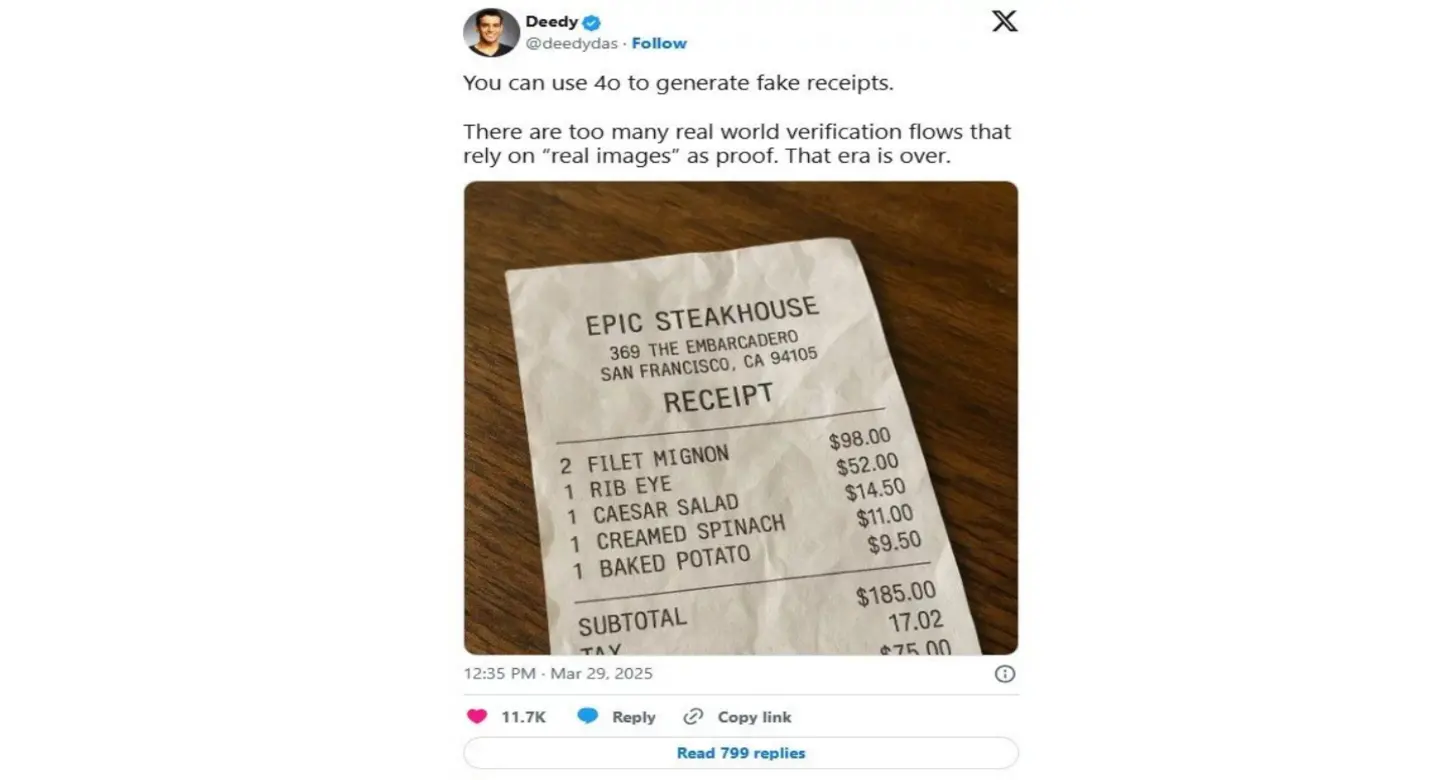

اخیراً مدل 4o چتجیپیتی قابلیت جدیدی برای تولید تصاویر را معرفی کرده که در آن توانایی خلق متنهای داخل تصاویر را به طور طبیعی دارد. این ویژگی به کاربران این امکان را میدهد که رسیدهای جعلی با ظاهری بسیار واقعی تولید کنند. نمونهای از این کاربردها در شبکه اجتماعی ایکس به اشتراک گذاشته شده، که در آن یک رسید جعلی از یک استیکهاوس معروف در سانفرانسیسکو منتشر شده است. جالب اینجاست که این رسید دارای لکههای غذا و نوشیدنی بوده تا به نظر واقعیتر برسد. این فناوری که در دسته دیپفیکهای هوش مصنوعی قرار میگیرد، به راحتی در اختیار کلاهبرداران قرار میگیرد و میتواند به یکی از ابزارهای جدید تقلب تبدیل شود.

این پیشرفت در هوش مصنوعی نگرانیهای جدیدی را در خصوص امنیت و اعتماد در فضای دیجیتال بهوجود میآورد. با قابلیتهای پیشرفتهای که در اختیار افراد قرار میگیرد، نه تنها امکان تقلبهای مالی بیشتر فراهم میشود، بلکه اعتماد به مدارک و مستندات دیجیتال نیز به شدت تحت تاثیر قرار خواهد گرفت. به نظر میرسد که فناوریهایی مانند چتجیپیتی میتوانند در آینده در اختیار بسیاری از افراد قرار گیرند و تغییرات عمدهای در امنیت سایبری و روشهای مبارزه با تقلب ایجاد کنند.

تولید رسیدهای جعلی با ChatGPT؛ فرصتهای جدید برای کلاهبرداران

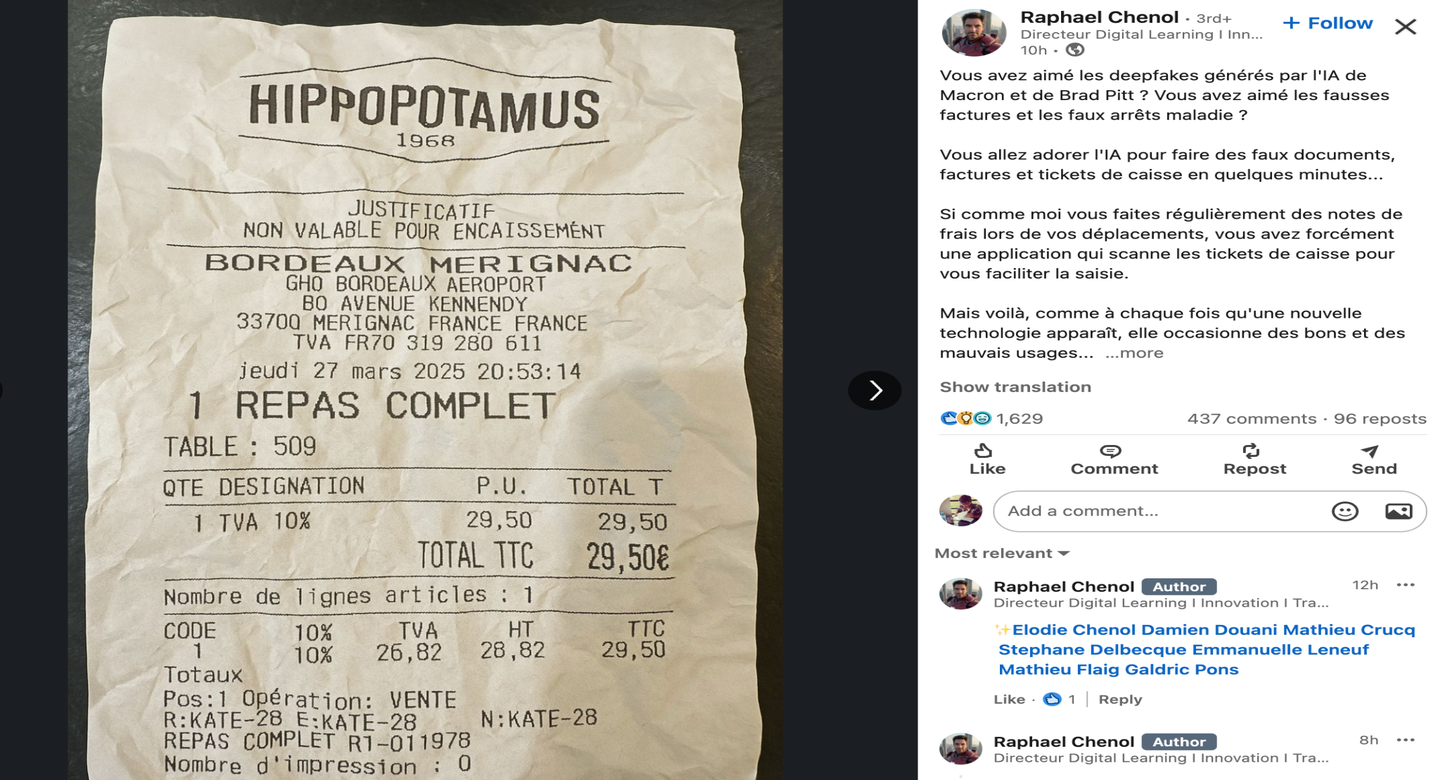

در فرانسه، یک کاربر در شبکه لینکدین تصویری از رسید جعلی منتشر کرد که بهوسیله هوش مصنوعی برای یک رستوران زنجیرهای ساخته شده بود و ظاهری کاملاً طبیعی داشت. این تصویر از قابلیتهای ChatGPT برای ایجاد رسیدهای جعلی استفاده میکرد و نشان میدهد که این فناوری بهراحتی میتواند در دست افراد سودجو قرار گیرد و ابزاری برای کلاهبرداریهای مختلف شود. استفاده از چنین تکنولوژیهایی برای انجام تقلبهای مالی، مثل دریافت بازپرداختهای جعلی، بهراحتی ممکن است.

با این حال، تایا کریستینسون، سخنگوی OpenAI، تأکید کرد که تمامی تصاویری که توسط چتجیپیتی تولید میشوند، حاوی متادیتاهایی هستند که نشان میدهند این تصاویر با استفاده از این ابزار ساخته شدهاند. او همچنین اظهار داشت که اوپنایآی در پی نظارت و مدیریت نقض سیاستهای خود است و همواره در تلاش است تا با استفاده از بازخوردها، عملکرد و امنیت مدلهای خود را بهبود بخشد. با وجود این توضیحات، هنوز این سوال باقی است که آیا فراهم کردن چنین ابزاری که بهسادگی میتواند به تقلبها دامن بزند، با سیاستهای ضدکلاهبرداری اوپنایآی در تضاد است یا خیر.

این پیشرفتهای فناوری در حوزههای مختلف میتواند فرصتهای جدیدی برای افراد خلاق ایجاد کند، اما به نظر میرسد که گاهی اوقات میتواند دست کلاهبرداران را نیز باز بگذارد. این وضعیت نشان میدهد که مسئولیتهای اخلاقی و نظارتی در هنگام طراحی و ارائه چنین ابزارهایی باید جدیتر گرفته شود تا از سوءاستفادههای احتمالی جلوگیری شود.